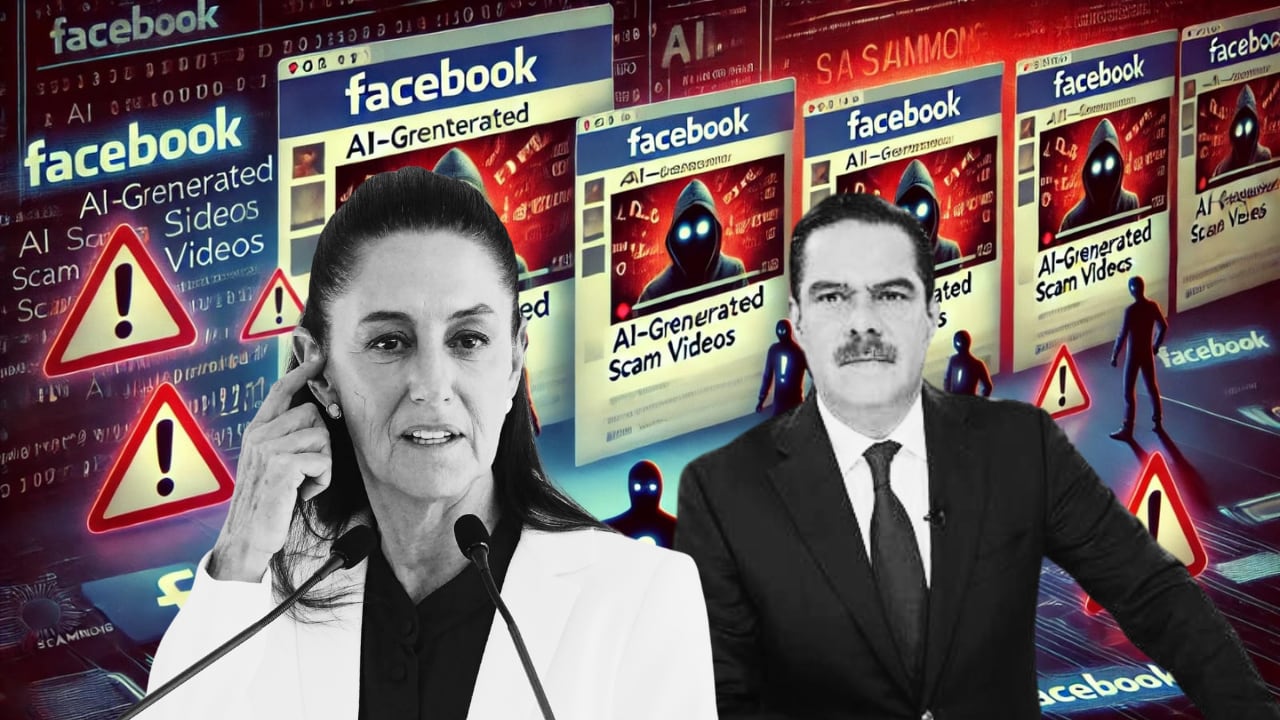

Una página de Facebook que se creó en 2023 bajo el nombre “Abierto Mexiquense” cambió su nombre a “Actos de la Semana” el pasado 2 de julio y, desde entonces, lanzó una campaña fraudulenta masiva, publicando más de 200 anuncios en la plataforma con la imagen de dos personajes públicos: el conductor de televisión Javier Alatorre y la candidata electa a la Presidencia, Claudia Sheinbaum.

A cada anuncio se le destinó una inversión de entre $100 y $200 dólares, lo que equivale a entre $1,781.51 y $3,563.02 pesos mexicanos al tipo de cambio actual. En total, se han invertido $3,822 dólares en esta campaña —cerca de $68,148 pesos—, centrando sus esfuerzos en usuarios del Estado de México, Ciudad de México, Veracruz, Jalisco, Puebla y Nuevo León.

Aunque Facebook ha eliminado algunas de estas publicaciones por no cumplir con las normas de transparencia, como señala en su Biblioteca de Anuncios —evitando así cobros adicionales que habrían sumado varios miles de dólares y aumentado el número potencial de víctimas—, la plataforma aún muestra 53 anuncios activos hasta este miércoles 10 de julio.

No obstante al posible alcance delictivo, este caso no es aislado. Iván Castañeda, especialista en Inteligencia de Fuentes Abiertas (OSINT), informó el pasado 1 de julio que hay al menos 55 enlaces de páginas de Facebook involucradas en fraudes similares, utilizando la imagen de Claudia Sheinbaum; todos con anuncios activos en la plataforma y alcanzando cientos de miles de vistas en cada uno de los videos fraudulentos.

Un modus operandi con un potencial daño masivo

Estos anuncios no solo se reproducen en Facebook, sino también en otras plataformas de Meta como Instagram, Messenger y Audience Network, que es una red de aplicaciones y sitios web que están fuera de las redes sociales, llevando la promoción de este esquema delictivo a múltiples páginas de Internet.

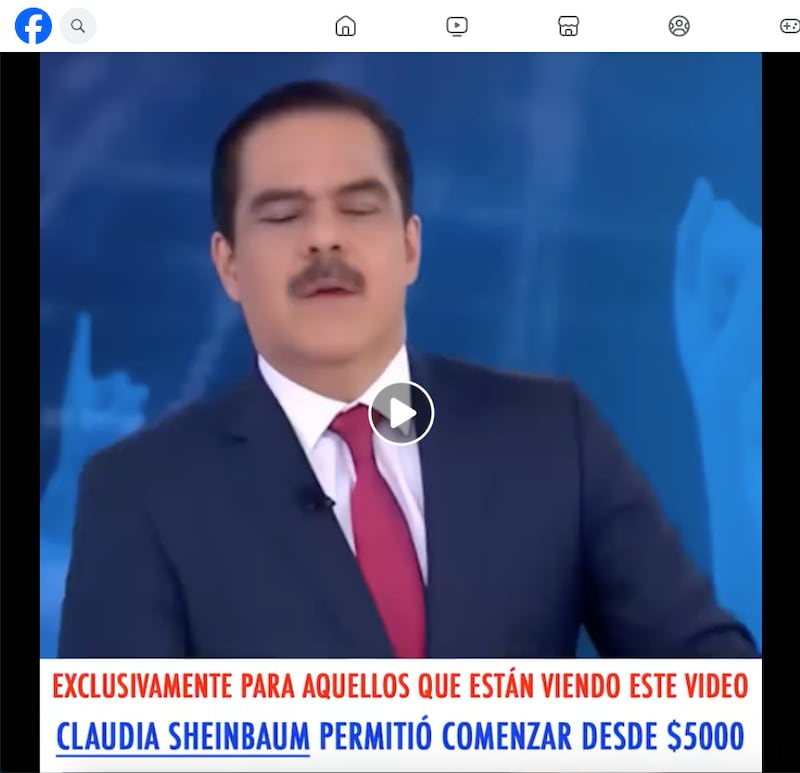

De esta manera, buscan engañar a las posibles víctimas en miles de sitios, disfrazando los anuncios como cápsulas informativas en donde el conductor de noticias Javier Alatorre, y la presidenta electa, Claudia Sheinbaum Pardo, hablan sobre una plataforma de inversión con resultados ‘milagro’.

En estos videos, Alatorre menciona que dicha plataforma promete rendimientos extraordinarios, mientras que Sheinbaum asegura que el gobierno ha probado la aplicación y garantiza su funcionalidad, aunque se trata de un evidente fraude y de una suplantación, tanto de su voz como de su gesticulación.

Acelerador delictivo

Con la voz clonada de Sheinbaum, y para atraer más víctimas, los suplantadores alertan que la plataforma cerrará en una o dos semanas, prometiendo ganancias de por vida a quienes logren registrarse a tiempo. Posteriormente, los usuarios que hacen clic en el anuncio son dirigidos a la página https://claumx[.]com, cuyo dominio fue registrado apenas el pasado 2 de julio.

¿Qué dicen las autoridades?

A pesar de las reiteradas advertencias y declaraciones públicas, no se ha informado sobre una indagatoria formal respecto a las víctimas de estas estafas. La Comisión Nacional para la Protección y Defensa de los Usuarios de Servicios Financieros (Condusef) ha emitido alertas sobre este tipo de fraude, pero no ha detallado si hay algún tipo de persecución del delito.

Esto ocurre a pesar de que el presidente Andrés Manuel López Obrador advirtió el pasado viernes 26 de abril que su imagen también ha sido utilizada en videos falsos generados con inteligencia artificial para esquemas de fraude. En esa ocasión, para una campaña que involucraba falsamente a Petróleos Mexicanos (Pemex) y al multimillonario Carlos Slim.

¿Cómo clonan la voz de Sheinbaum y Alatorre?

La tecnología de inteligencia artificial ha avanzado significativamente, facilitando la creación de videos falsos de personajes públicos mediante la clonación de voz y la manipulación de movimientos faciales. Herramientas accesibles en línea permiten a cualquier persona con conocimientos básicos generar videos convincentes en cuestión de horas, democratizando el acceso a esta tecnología.

Estos deepfakes se difunden rápidamente a través de redes sociales y plataformas de video como YouTube, Twitter y TikTok, alcanzando una amplia audiencia en poco tiempo. La facilidad de creación y la aparente autenticidad de estos videos los convierte en una herramienta peligrosa para la desinformación.

Plataformas de software como DeepFaceLab o aplicaciones como Resemble AI han democratizado el acceso a esta tecnología, lo que significa que la creación de estos videos ya no está reservada para expertos en efectos especiales.