El uso de inteligencia artificial (IA) para crear videos y audios falsos, conocidos como deepfakes, ha generado un aumento en los casos de fraude y desinformación en todo el mundo. Figuras públicas como políticos, artistas y empresarios son las principales víctimas de esta tecnología, que permite suplantar su imagen o voz con fines maliciosos.

Según un informe de Sumsub, plataforma especializada en identidad y cumplimiento normativo, México ha registrado un aumento considerable en los incidentes relacionados con deepfakes. Entre 2022 y 2023, los casos incrementaron un 500%. Además, las tasas de fraude de identidad también han experimentado un repunte significativo, triplicándose del 0.48% en 2021, al 1.27% en 2023.

Hoy en día, todos podemos tener acceso a la IA generativa para crear o modificar el aspecto de un personaje. Hugo Monroy, Business Development en Xira, indica que ya existen aplicaciones o software de edición que tienen implementadas estas herramientas.

Celebridades más falsificadas por IA

Las celebridades más falsificadas suelen ser figuras que tienen un impacto global, ya que sus imágenes y videos son fácilmente accesibles y, a menudo, utilizados para generar contenido engañoso, humorístico o problemático. A continuación, algunas de las celebridades más afectadas por falsificaciones, especialmente mediante deepfakes y manipulación de audio y video:

El Papa (Jorge Mario Bergoglio), Taylor Swift, Lady Gaga, Ryan Reynolds, Scarlett Johansson (voz), Jennifer Aniston (voz), Dwayne Johnson (La Roca), Oprah (voz), Elon Musk (voz e imagen), Vladimir Putin, Barack Obama, Hillary Clinton y Donald Trump, entre otros.

De acuerdo con la Encuesta Global de Seguridad Online 2024 de Microsoft, el 71% de las personas que usan redes sociales consideran las estafas como su principal preocupación en relación con los problemas potenciales que puede generar la IA.

En segundo lugar, un 69% de los encuestados señalan las deepfakes y el abuso sexual en línea como problemas significativos. Otras preocupaciones incluyen las alucinaciones generadas por herramientas de IA (66%), la privacidad de los datos (62%) y la amplificación de prejuicios (60%).

Santiago Fajer, director de Xira, especialista en ciberseguridad, ha alertado sobre el peligro de que los deepfakes sean utilizados para cometer fraudes financieros, extorsiones o difundir noticias falsas.

Algunas celebridades, como Scarlett Johansson, también han sido víctimas de este tipo de tecnologías en contextos más privados, como la creación de contenido explícito sin su consentimiento.

“Las plataformas digitales y redes sociales están comenzando a implementar herramientas de detección para combatir esta problemática. Sin embargo, la rápida evolución de la IA está desafiando la capacidad de estas plataformas para identificar de manera efectiva los videos manipulados”.

— Santiago Fajer

Delito de suplantación de identidad

En temas legislativos, México cuenta con la Ley Olimpia, una de las legislaciones más avanzadas en temas de violencia sexual digital, que tipifica la manipulación de imágenes a través de la IA como un delito de violencia digital. Esta ley contempla sanciones económicas, así como condenas de hasta seis años de prisión.

La normativa ante el uso de IA todavía no está del todo definida tanto en México como en otros países. Sin embargo, a principios de septiembre se firmó un tratado internacional para la regulación de esta tecnología, en el que participaron diversos países, incluido México.

Los expertos de Xira comentan que también existen leyes internacionales que promueven la implementación de advertencias en los contenidos digitales para alertar si ciertos videos o fotografías están hechos con esta tecnología.

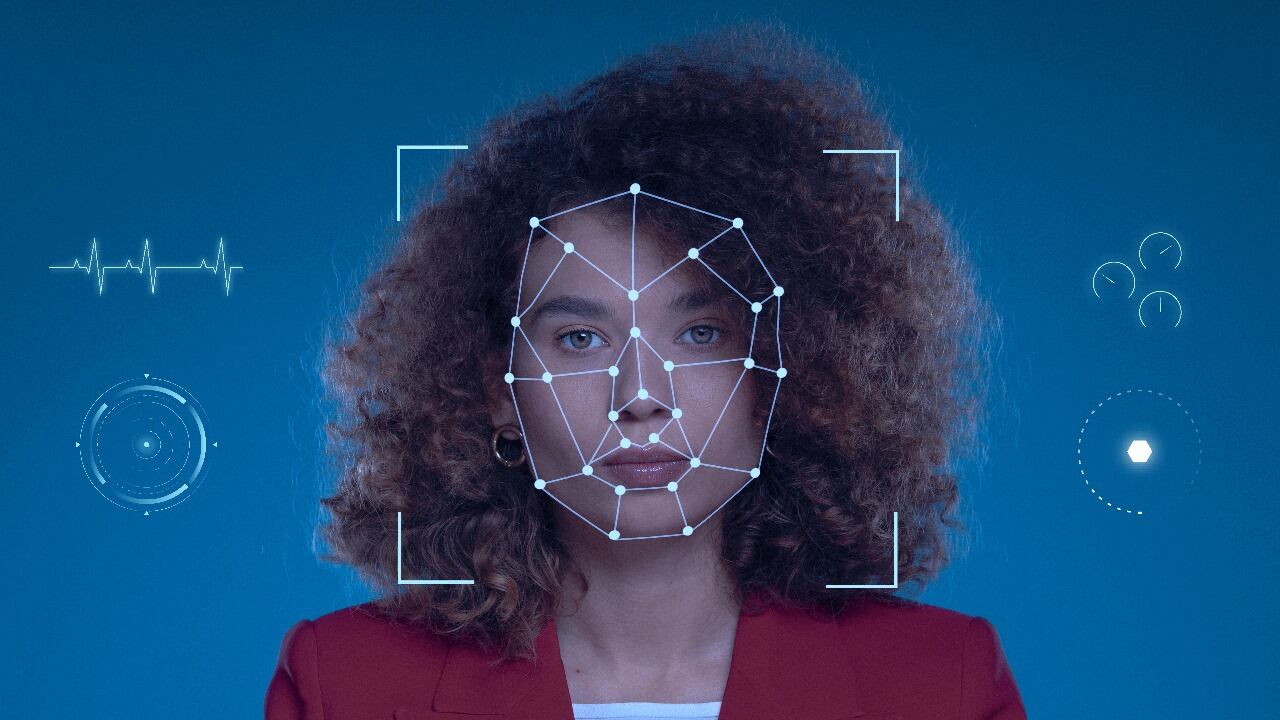

¿Cómo identificar un deepfake?

Los especialistas en IA recomiendan a los usuarios estar atentos a señales de falsificación. Por ello, es importante prestar atención al movimiento de la boca, las manos, el rostro, los ojos y otros elementos corporales para detectar anomalías en la calidad y continuidad de la imagen. De igual manera, se debe observar la relación entre la voz y el movimiento de los labios.